Gesetze normieren menschliches Verhalten und nicht die Automatisierungsfolgen von „Maschinen“

Einleitung

Die neuen Technologien der „künstlichen Intelligenz“ (KI) werden Wirtschaft und Gesellschaft, aber auch das Recht verändern.

Die Erwartungen und Hoffnungen sind hoch, ebenso die Ängste und Befürchtungen.

Die Zahl der Studien, die sich mit der Entwicklung, Verwendung und Regulierung von künstlicher Intelligenz (KI) befassen, nimmt täglich zu.

Grundlagen der KI

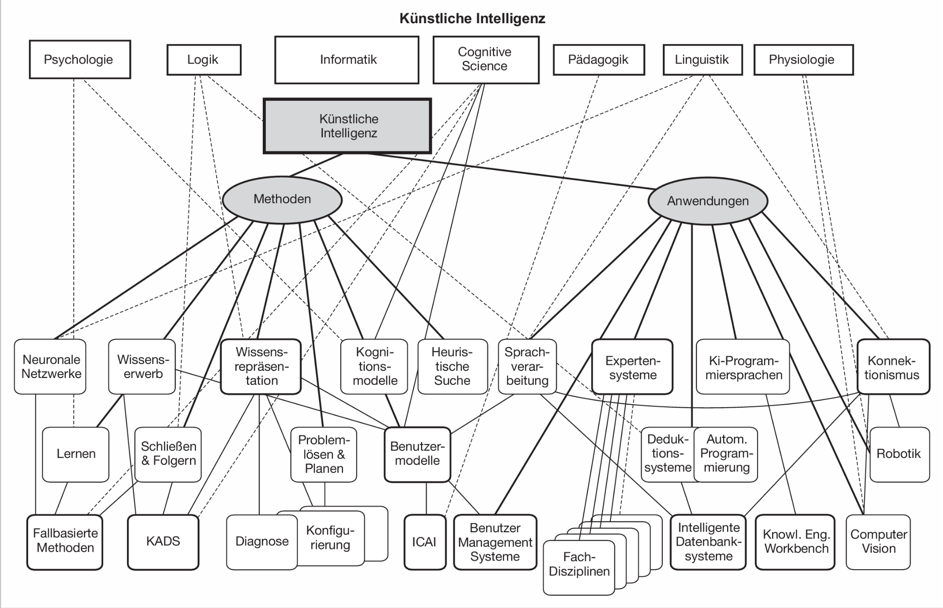

Die Künstliche Intelligenz (KI) ist nicht ein Gegenstand, sondern das Ergebnis aus mehreren Elementen, wie:

- Künstlich intelligente Softwaresysteme, die stets eine Machine Learning-Komponente enthalten sollten

- Gelabelte Daten

- Kombination von Algorithmen und Daten

- etc.

Um alles lösen zu können, was das menschliche Hirn erfassen und bewältigen kann, müssen gleiche oder ähnliche Kognitionen, Methoden und Anwendungen in intelligenten Softwaresystemen programmiert werden.

In Zukunft dürfte auch die Abgrenzung der „Systeme künstlicher Intelligenz“ von „gewöhnlicher Software“ ein Thema bilden.

Immer mehr Anwendungsbereiche für KI

Die Anwendungen von KI sind vielfältig:

- Monitoring von Daten

- Optimierung administrativer Prozesse

- Analyse

- Diagnose

- Entscheidungsunterstützungssysteme

- selbstfahrende Autos

- etc.

Die KI-Unterstützung wirft neue Fragen auf.

Kritische Aspekte der KI-Unterstützung und Folgen

Es stellt sich insbesondere die Frage nach der Verantwortung für fehlerhafte, KI-basierte Entscheidungen.

In den neueren Studien wurden – ohne Anspruch auf Vollständigkeit – folgende Problemfelder, die Folge der KI-Algorithmen sind, ausgemacht:

- Datenschutz

- Beispiele:

- Wer hat Zugriff zu den Daten?

- Wofür werden die Daten verwendet?

- Beispiele:

- Sicherheit

- Beispiel:

- Selbstfahrendes Auto (Todesfall mit UBER-Fahrzeug in Arizona)

- Beispiel:

- Ethik

- Beispiel:

- KI-Entscheidung während Kollisionsvorgang und Priorisierung der Betroffenen (Einzelperson vor Personengruppe, älterer Mensch vor Kind usw.)

- Beispiel:

- Diskriminierung

- Beispiel:

- Bewerbungsalgorithmus von „Amazon“ (Selektionierung nur von Männern und nie von Frauen)

- Beispiel:

- Zukunft der Arbeit

- Beispiel:

- Arbeitsplatzverlust durch KI

- Beispiel:

- Recht

- Beispiel Urheberrecht:

- Besteht ein Immaterialgüterschutz an KI-Erzeugnissen (Urheberschutz zugunsten der Maschine mit KI, zugunsten der Programmierer oder Ausweitung auf Schutz für Datenbanken)

- Beispiel Obligationenrecht (OR):

- anwendbare Normen für automatisierte Vertragsabschlüsse (auf menschliches Handeln ausgerichtetes OR / Normierungslücken für maschinelles Handeln (elektronische Agenten von Online-Plattformen bzw. Internetshops)

- Beispiel Haftpflichtrecht:

- Haftung bei selbstfahrenden Autos (Fahrer, Automobilhersteller oder Hersteller der KI) oder für elektronische Agenten im Geschäftsverkehr (Plattformen) > Im Zweifelsfall gilt der Mensch als der Verursacher

- Beispiel Versicherungsrecht:

- Deckung der Haftungsrisiken bei mehrteiliger Verantwortung.

- Beispiel Urheberrecht:

Erfordernis von KI-Regulatorien

Für die erwähnten Algorithmen-Problemfelder besteht, sofern und soweit die geltende Rechtsordnung nicht greift oder Lücken enthält, ein Regulierungsbedarf. Zu berücksichtigen sind wohl und neu die Unternehmen, die die KI entwickeln, einsetzen oder mit ihren Produkten verkaufen.

Viele Organisationen und Institutionen auf nationaler und internationaler Ebene haben die Relevanz der KI-Problematik erkannt und Arbeitsgruppen gebildet. Diese Arbeitsgruppen sind daran, Richtlinien für einen fairen und vertrauensvollen Umgang mit KI zu erarbeiten.

Werte / Ethik

Zur Bestimmung der KI-Grenzen und für das einfliessen lassen ethisch vertretbarer Wertvorstellungen sind die folgenden moralischen Eigenschaften ein zentrales Diskussionsthema in den Gesprächen der Organisationen und Institutionen:

- Transparenz

- Fairness

- Nichtdiskriminierung

Schwierige Fassbarkeit der Werte

Im Rahmen solcher Richtlinien-Diskussionen wurde deutlich, dass die KI-Anwendung an Grenzen stösst und sich gewisse Dilemmas nicht lösen lassen:

- Transparenzloses Maschinelles Lernen

- Beim maschinellen Lernen werden Entscheidungswege nicht transparent

- Fairness-Definition

- Definition des Fairnessbegriffes (Konsumenten, Unternehmen und Behörden haben ein unterschiedliches Fairness-Verständnis)

- Fortschritt vs. unethischer KI-Einsatz

- Grenze zwischen sinnvoller Optimierung und unethischer Anwendung

Positive Prognose für KI

Trotz aller Bedenken geht man heute von einem vielversprechendem Potenzial der KI aus und, dass das Gute (Mobilität, Gesundheitsvorsorge etc.) am Ende das Schlechte (Unfälle von selbstfahrenden Autos, Fehldiagnosen usw.) überwiegen wird.

Fazit

In der Schweiz hat die KI-Diskussion erst begonnen, obwohl die KI-Technologie zunehmend zum Einsatz gelangt. Es sollte nicht sein, dass die ethische Auseinandersetzung und die darauf aufbauenden Richtlinien und Prinzipien hinterherhinken. Es ist daher zu hoffen, dass die interessierten Personenkreise baldmöglichst einen Verhaltenskodex, einen sog. „Code of Conduct“ (CoC KI), vorlegen.

Quelle

LawMedia Redaktionsteam

Weiterführende Informationen / Linktipps

- Wirtschaft: Globale Board-Umfrage 2018

- Forschungsstandort Schweiz – Künstliche Intelligenz: Pro und Contra | ansiedlung-schweiz.ch

- Unternehmensjuristen – Software für Rechtsabteilung | wolterskluwer.de

- Im Zweifelsfall ist der Mensch der Verursacher | sueddeutsche.de

Literaturverzeichnis

- BECK SUSANNE, Der rechtliche Status autonomer Maschinen, AJP 2017, 183 ff.

- BERGER BERNHARD, Zur Unterscheidung zwischen Rechtsscheinhaftung und Vertrauenshaftung – Zugleich eine Besprechung von BGE 128 III 324, recht 2002, 201 ff.

- CORNELIUS KAI, Vertragsabschluss durch autonome elektronische Agenten, MMR 2002, 353 ff.

- EZRACHI ARIEL / STUCKE MAURICE E., Artificial Intelligence & Collusion: When Computers Inhibit Competition, 2017 University of Illinois Law Review, 1775 ff.

- GAL MICHAL S. / ELKIN-KOREN NIVA, Algorithmic Consumers, 30 Harvard Journal of Law & Technology, 309 ff.

- GLANCE DAVID, Will the Elderly Rely on the Internet of Things to Look after Them?, Phys. Org vom 18. August 2015 <http://phys.org/news/2015-08-elderly-internet.html>.

- KIANICKA MICHAEL MARTIN, Die Agentenerklärung: Elektronische Willenserklärungen und künstliche Intelligenz als Anwendungsfall der Rechtsscheinhaftung, Zürich 2012.

- KIM NANCY S., Alternate Vision of Contract Law in 2025, 52 Duquesne University Law Review, 303 ff.

- PEPPET SCOTT R., Regulating the Internet of Things: First Steps towards Managing Discrimination, Privacy, Security, and Consent, 93 Texas Law Review, 85 ff.

- SCHERER MATTHEW U., Regulating Intelligence Systems: Risks, Challenges, Competencies, and Strategies, 29 Harvard Journal of Law & Technology, 353 ff.

- VAN GORP NICOLAI / BATURA OLGA, Challenges For Competition Policy in a Digitalised Economy, Study for the ECON Committee of the European Parliament vom Juli 2015 (IP/A/ECON/2014-12).

- WEBER ROLF H., E-Commerce und Recht: Rechtliche Rahmenbedingungen elektronischer Geschäftsformen, Zürich 2010.

- WÖLFLE RALF / LEIMSTOLL UWE, E-Commerce-Report Schweiz 2017: Digitalisierung im Vertrieb an Konsumenten. Eine qualitative Studie aus Sicht der Anbieter, 9. Aufl., Olten 2017.